Foto: cs.appstate.edu

Teknologi.id – Dalam beberapa tahun terakhir, penggunaan AI di perusahaan besar meningkat pesat, terutama untuk kebutuhan prediksi seperti churn pelanggan, fraud detection, dan proyeksi permintaan. Model AI mampu menghasilkan output dengan akurasi tinggi, sehingga banyak organisasi mulai mengandalkannya sebagai dasar pengambilan keputusan berbasis data.

Namun, AI memiliki keterbatasan utama: model hanya memberikan hasil tanpa menjelaskan alasan di baliknya. Di sinilah pendekatan causal menjadi penting, karena perusahaan tidak hanya butuh tahu apa yang akan terjadi, tetapi juga mengapa hal itu terjadi. Tanpa pemahaman causal, AI hanya menjadi alat prediksi, bukan alat pengambilan keputusan yang kuat.

Masalah ini semakin terlihat ketika data berubah. AI bisa menangkap pola yang terlihat benar, tetapi belum tentu memiliki hubungan sebab-akibat. Tanpa pendekatan causal dalam AI, keputusan yang diambil berisiko tidak relevan, meskipun secara data terlihat akurat.

Keputusan Tidak Akurat dan Sulit Dipertanggungjawabkan

Ketika organisasi mengandalkan model berbasis korelasi, risiko yang muncul tidak hanya terkait akurasi, tetapi juga validitas keputusan. Model dapat memberikan hasil yang secara statistik benar dalam data historis, tetapi gagal ketika kondisi berubah. Hal ini terjadi karena model tidak memahami hubungan kausal yang mendasari data tersebut.

Di lingkungan data sensitif seperti sektor finansial, kesehatan, atau pemerintahan, masalah ini menjadi lebih kompleks. Keputusan tidak hanya harus akurat, tetapi juga harus dapat dijelaskan dan dipertanggungjawabkan. Ketika model tidak mampu memberikan penjelasan yang jelas, kepercayaan terhadap sistem menurun, baik dari sisi internal maupun regulator.

Selain itu, ketergantungan pada korelasi dapat menghasilkan bias yang tidak terlihat. Model dapat menangkap pola yang sebenarnya tidak relevan secara kausal, tetapi tetap digunakan dalam pengambilan keputusan. Dalam jangka panjang, hal ini dapat menciptakan risiko yang lebih besar dibandingkan manfaat yang dihasilkan.

Baca Juga: Mengapa Banyak Proyek AI Gagal di Tahap Produksi?

Lingkungan Sensitif Membutuhkan Transparansi dan Causality

Foto: shutterstock.com

Kebutuhan akan pendekatan yang lebih transparan dan dapat dijelaskan semakin meningkat, terutama di lingkungan dengan regulasi ketat. Hal ini terlihat dari bagaimana European Union mengembangkan regulasi AI yang menekankan pentingnya explainability dan accountability dalam penggunaan sistem berbasis AI.

Pendekatan ini muncul karena banyak sistem AI berbasis black-box tidak dapat menjelaskan bagaimana keputusan dibuat. Dalam konteks data sensitif, kondisi ini tidak dapat diterima karena setiap keputusan harus memiliki dasar yang jelas dan dapat diaudit. Tanpa kemampuan ini, AI berpotensi menimbulkan risiko hukum dan operasional yang signifikan.

Kasus ini menunjukkan bahwa masa depan AI tidak hanya bergantung pada akurasi prediksi, tetapi juga pada kemampuan untuk menjelaskan hubungan sebab-akibat di balik setiap keputusan. Tanpa causality, AI akan selalu memiliki batas dalam penggunaannya di lingkungan yang kritikal.

Beralih dari Correlation ke Causation

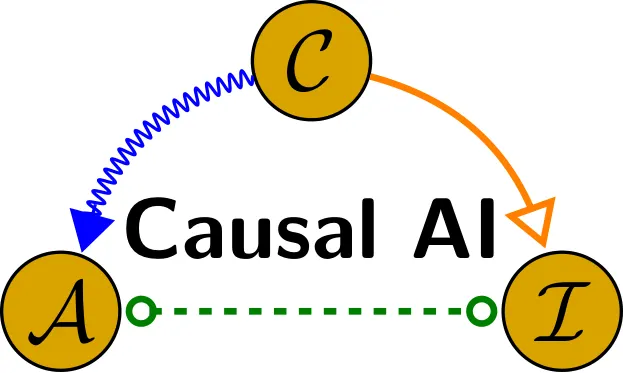

Sebagai respons terhadap keterbatasan ini, muncul pendekatan yang dikenal sebagai Causal AI. Berbeda dengan machine learning tradisional yang fokus pada korelasi, Causal AI bertujuan untuk memahami hubungan sebab-akibat dalam data. Pendekatan ini memungkinkan organisasi untuk tidak hanya mengetahui apa yang terjadi, tetapi juga mengapa hal tersebut terjadi.

Dengan memahami causality, model dapat digunakan untuk mensimulasikan berbagai skenario dan memprediksi dampak dari suatu keputusan sebelum keputusan tersebut diambil. Hal ini memberikan kemampuan yang jauh lebih kuat dibandingkan sekadar prediksi berbasis data historis.

Namun implementasi Causal AI tidak sederhana. Dibutuhkan pemahaman mendalam mengenai struktur data, hubungan antar variabel, serta metode yang tepat untuk mengidentifikasi hubungan kausal. Banyak organisasi mengalami kesulitan dalam mengadopsi pendekatan ini karena kompleksitas yang tinggi.

Sagara sebagai Sistem Causal AI yang Terintegrasi

Sagara menghadirkan pendekatan Causal AI sebagai sistem yang terintegrasi, bukan sekadar metode analisis tambahan. Pendekatan ini dirancang untuk membantu perusahaan memahami hubungan sebab-akibat dalam data secara sistematis dan terstruktur.

Dalam sistem ini, data tidak hanya diproses untuk menemukan pola, tetapi juga untuk mengidentifikasi struktur kausal yang mendasari pola tersebut. Model dibangun dengan mempertimbangkan hubungan antar variabel, sehingga hasil yang dihasilkan tidak hanya berupa prediksi, tetapi juga insight yang dapat dijelaskan.

Pendekatan ini memungkinkan organisasi untuk mengambil keputusan yang lebih akurat dan lebih dapat dipertanggungjawabkan. AI tidak lagi menjadi black-box, tetapi menjadi alat yang transparan dan dapat diaudit.

Keputusan Lebih Akurat, Transparan, dan Dapat Diaudit

Dengan menggunakan pendekatan Causal AI, organisasi dapat meningkatkan kualitas pengambilan keputusan secara signifikan. Keputusan tidak lagi didasarkan pada korelasi semata, tetapi pada pemahaman yang lebih dalam mengenai hubungan sebab-akibat. Hal ini mengurangi risiko kesalahan yang disebabkan oleh pola yang tidak relevan.

Selain itu, transparansi yang dihasilkan memungkinkan organisasi untuk menjelaskan keputusan yang diambil dengan lebih jelas. Hal ini sangat penting dalam lingkungan yang membutuhkan akuntabilitas tinggi, seperti sektor finansial dan pemerintahan.

Dalam jangka panjang, pendekatan ini juga meningkatkan kepercayaan terhadap sistem AI. Stakeholder dapat memahami bagaimana keputusan dibuat, sehingga lebih mudah untuk menerima dan mengandalkan sistem tersebut.

Dari Black-Box ke Sistem yang Dapat Dijelaskan

Sebuah institusi finansial sebelumnya menggunakan model machine learning tradisional untuk mendeteksi risiko kredit. Model tersebut memiliki akurasi yang tinggi, tetapi sulit dijelaskan karena bekerja sebagai black-box. Ketika terjadi penolakan terhadap pengajuan kredit, tim kesulitan memberikan alasan yang jelas kepada nasabah maupun regulator. Kondisi ini tidak hanya menimbulkan ketidakpastian, tetapi juga meningkatkan risiko kepatuhan karena keputusan tidak dapat diaudit secara transparan.

Setelah mengadopsi pendekatan Causal AI dari Sagara, institusi tersebut dapat mengidentifikasi faktor-faktor penyebab yang secara langsung memengaruhi keputusan model. Setiap output tidak lagi sekadar hasil prediksi, tetapi dilengkapi dengan penjelasan berbasis hubungan sebab-akibat yang terstruktur. Sagara memungkinkan setiap keputusan ditelusuri kembali ke variabel yang relevan, sehingga memberikan dasar yang jelas dan dapat dipertanggungjawabkan.

Dengan pendekatan ini, transparansi meningkat secara signifikan. Tim dapat menjelaskan alasan di balik setiap keputusan kepada nasabah maupun regulator dengan lebih percaya diri. Selain itu, model menjadi lebih stabil karena tidak lagi bergantung pada pola korelasi yang bersifat sementara, melainkan pada hubungan yang memiliki makna kausal.

Perubahan ini menunjukkan bahwa kemampuan untuk memahami causality bukan hanya meningkatkan kualitas model, tetapi juga membangun kepercayaan terhadap sistem. Dengan Sagara sebagai fondasi, AI tidak lagi menjadi black-box, melainkan sistem yang dapat dijelaskan, diaudit, dan digunakan dalam lingkungan yang membutuhkan tingkat akuntabilitas tinggi.

Baca Juga: Berapa Biaya Sebenarnya untuk Rekrut & Train Developer AI di Indonesia?

Dari Prediksi ke Pemahaman yang Lebih Dalam

Perusahaan tidak lagi cukup hanya mengetahui apa yang akan terjadi. Mereka perlu memahami mengapa hal tersebut terjadi agar dapat mengambil keputusan yang lebih tepat. Pendekatan berbasis korelasi memiliki batas yang tidak dapat diatasi tanpa memahami causality.

Causal AI membuka peluang untuk melampaui batas tersebut dengan memberikan pemahaman yang lebih dalam terhadap data. Dalam konteks ini, solusi yang dibutuhkan bukan sekadar model yang lebih kompleks, tetapi sistem yang mampu mengelola hubungan sebab-akibat secara konsisten.

Sagara memposisikan diri sebagai sistem tersebut mengubah AI dari alat prediksi menjadi alat pengambilan keputusan yang transparan, dapat dijelaskan, dan siap digunakan dalam lingkungan data sensitif.

Baca Berita dan Artikel lainnya di Google News

(FIK/SH)